エンド・ツー・エンド光映像配信アーキテクチャ技術

IOWNによる多地点をオンデマンドに結ぶ低遅延なライブ配信の実現に向けて

技術背景・課題

近年、放送事業者やOTTサービス事業者による映像、番組制作では、クラウドサービスなどによるリモートプロダクションが広く利用されるようになりました。これにより、映像素材を集約して番組制作を進めることができ、従来のような、全国各地の拠点で番組制作を行うことと比較して、制作作業を効率化することができます。一方で、映像データは4K、8Kと高精細化、大容量化が進んでおり、素材集約のためのネットワークコストや、処理量の増加に伴うクラウドサービスコスト、そして一連のシステムの消費電力についても、さらなる増加が見込まれます。

このような中、私たちは、映像処理を行うGPUなどのリソースを光電融合デバイスでチェイニングし、APNと直接接続するエンド・ツー・エンド光映像配信アーキテクチャにより、このような課題の解決をめざしています。

技術の概要・特徴・内容

ポイントとなる要素技術としては、①ネットワーク内映像処理技術、②番組編成に応じた動的素材伝送パス切替技術があります。

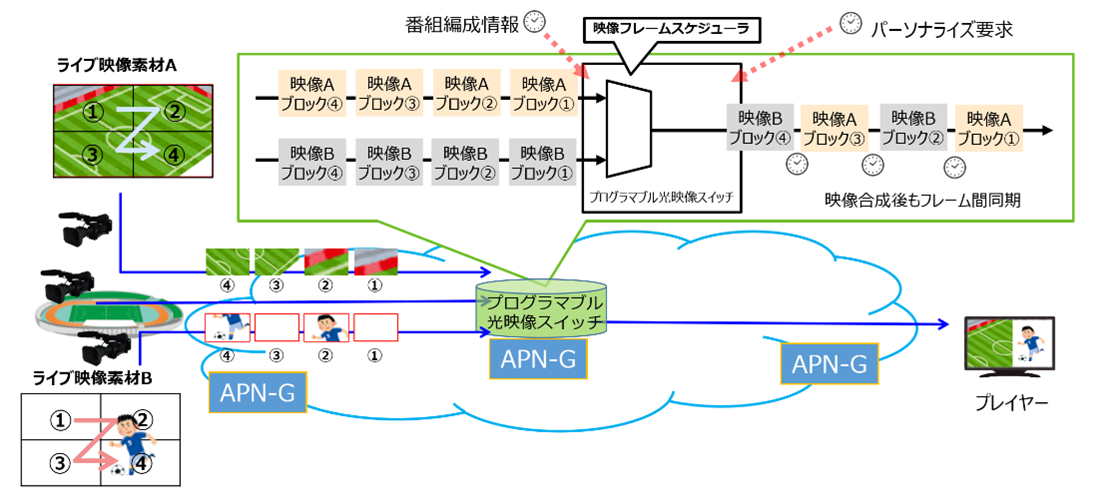

①ネットワーク内映像処理技術は、APN上に配備された、プログラマブル光映像スイッチ内にあり、映像ブロック単位での処理により、ネットワーク上での映像加工、編集等を可能にする技術です。一般的なスイッチャーなどの映像用装置を用いずに映像処理が実行でき、映像データを映像信号やファイル形式に変換せずに、低遅延の映像編集、配信機能を実現します。②番組編成に応じた動的素材伝送パス切替技術は、サービス事業者からの編成情報をもとに、オンデマンドにパス/経路制御、リソース割り当てを行うことで、ネットワークリソースの利用の効率化を実現します。

技術目標・成果・効果

エンド・ツー・エンド光映像配信アーキテクチャ技術の実現に向けて、放送業界で普及が進んでいる非圧縮映像の伝送規格である、SMPTE ST2110をベースしたシステムの開発を進めています。業界標準との相互接続性も考慮し、利用しやすい技術を目指しています。

現在の開発システムでは以下の機能実装、評価を行っています。

映像処理機能

ネットワーク装置やサーバを用いて、SMPTE ST2110によって伝送される通信データを直接処理するネットワーク内映像処理技術により、映像の切り替えや合成といった映像処理を実現する機能です。複数の映像素材に対して、編成情報やユーザからのパーソナライズ要求をもとに、ネットワーク上を流れる通信データを映像ブロック毎に書き換えなどを行います。具体的には、通信データに含まれる情報から、エンコード時刻、映像フレームの情報、映像フレーム内のピクセル座標情報などから映像データを判別し、処理を行います。(図1参照)

遅延調整・同期機能

多地点の映像素材を集約して映像処理を行う場合、伝送遅延の差により、映像処理機能への映像入力のタイミングにずれが生じる可能性があります。さらに、今後、映像素材に対してAI処理などの編集をリアルタイムで適用するケースも増えてくると考えられますが、この場合は、映像を入力してAI処理後の映像が出力されるまでの処理時間が発生し、特にライブ配信等のユースケースでは問題になることが想定されます。そこで、ネットワーク内映像処理技術により、映像の伝送遅延と、処理時間によるタイミングのずれを調整し、複数の映像を同期する機能を提供します。(図2参照)

オンデマンド制御機能

映像素材の収集、制作においては、サービス事業者の要求にオンデマンドに対応して、必要なネットワーク、映像伝送や処理の機能を提供することが重要です。そこで、前述の映像処理機能のほか、ネットワークの経路制御をオンデマンドに実行する、番組編成に応じた動的素材伝送パス切替技術を検討しています。具体的には、サービス事業者の編成システムとのインタフェースを規定し、編成情報に基づいて、APNの光パスの設定、経路構築を行い、指定された時刻においてフレーム精度で映像を切り替える動作を実現します。

想定される適用分野・PoC

エンド・ツー・エンド光映像配信アーキテクチャ技術は、リアルタイム性が求められる低遅延ライブ配信、リモートプロダクション等への適用が想定されます。

今後の展望

低遅延なライブ配信を実現するエンド・ツー・エンド光映像配信アーキテクチャ技術について紹介しました。今後は、引き続き映像制作、映像配信に必要な機能の検討を進めるほか、大規模配信を想定したスケール性などの検討にも取り組み、実用化に向けた研究開発を進めていきます。